Table of Contents

- Introduzione

- Il coefficiente di correlazione tra ranghi (misure ordinali)

- Verifica delle ipotesi su rs di Spearman

- Il coefficiente di correlazione tra variabili dicotomiche rphi

- Verifica delle ipotesi su rphi

Introduzione

Spesso capita di non avere a disposizione delle misure di tipo metrico per le due variabili, X e Y, che si pensa possano essere associate.

Se si hanno scale dicotomiche o ordinali, vi sono una varietà di coefficienti concettualmente simili alla r di Pearson.

Se si dispone di frequenze, un coefficiente calcolato su una tabella di contingenza consente di indagare ipotesi di associazione.

Esempio

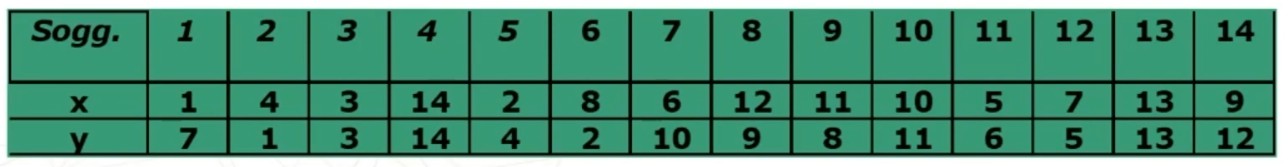

Per capire meglio facciamo un esempio e immaginiamo di aver osservato i comportamenti aggressivi e quelli oppositivi di 14 adolescenti durante le loro interazioni con i genitori.

Preferiamo misurare le due variabili come due graduatorie (dal meno aggressivo al più aggressivo; dal meno oppositivo al più oppositivo).

Non possiamo utilizzare r di Pearson poichè la graduatoria indica il livello di misura ordinale; non abbiamo misure metriche.

Osserviamo la seguente distribuzione di frequenze:

Quando abbiamo a che fare con queste tipi di variabili (non metriche) dobbiamo usare i coefficienti non parametrici. Questi devono essere utilizzati anche quando una sola delle due variabili in relazione non raggiunge il livello metrico di misurazione.

Un esempio di coefficiente di correlazione non parametrico è quello della correlazione tra ranghi rs di Spearman

Il coefficiente di correlazione tra ranghi (misure ordinali)

Il coefficiente rs va calcolato quando i dati sono costituiti da ranghi (graduatorie), oppure quando una delle variabili è ordinale, e l’altra metrica (previa trasformazione in rango).

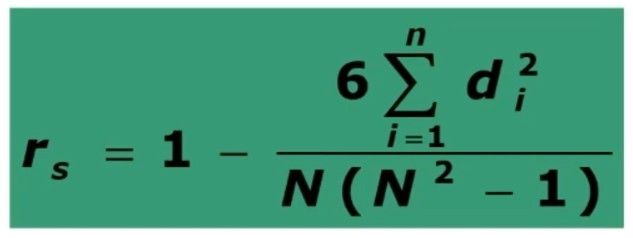

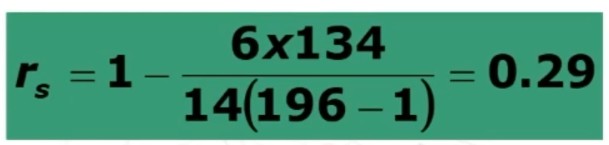

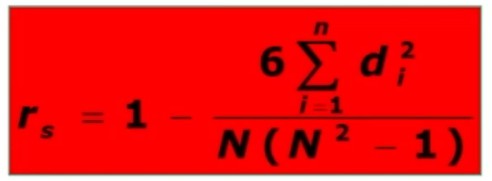

Il coefficiente di correlazione rₛ si basa sulle differenze d tra i ranghi attribuiti a ciascuna coppia di valori e può essere calcolato tramite la formula:

dove:

- di = differenza tra i ranghi di ciascuna coppia di punteggi

- n = numero dei soggetti (o coppie di punteggi)

Quando i ranghi delle due graduatorie coincidono tutte le d=0 quindi

Quindi rs = 1, oppure quando le posizioni in graduatoria sono esattamente opposte il coefficiente sarà rs = -1 (correlazione negativa perfetta)

Esempio

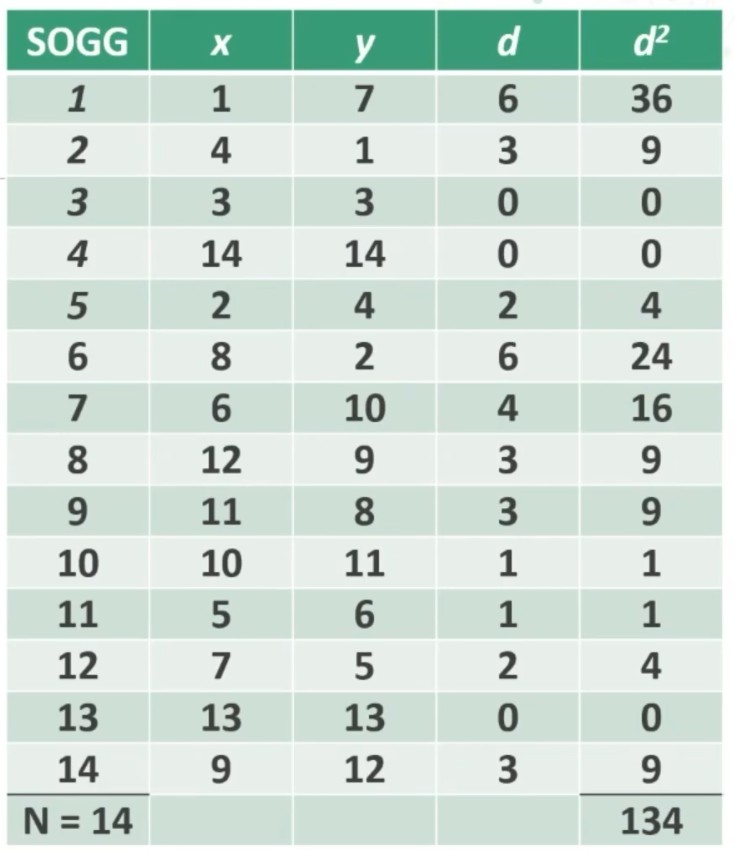

ESEMPIO: Comportamenti aggressivi (x) e oppositivi (y) di 14 adolescenti. Ciascun soggetto è stato classificato sulla base di due variabili ordinali (graduatorie).

La colonna d corrisponde alle differenze, l’ultima colonna alle differenze al quadrato.

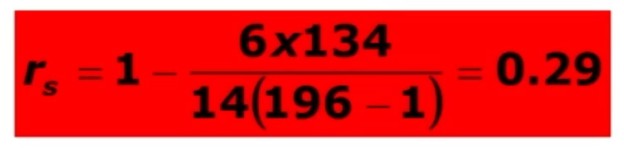

Il coefficiente risulta:

Verifica delle ipotesi su rs di Spearman

Come posso valutare se la relazione sintetizzata tramite il coefficiente di correlazione rₛ è significativa, cioè probabilisticamente diversa da zero?

L’ipotesi viene verificata sul ρₛ (rhoₛ), dove ρₛ = parametro nella popolazione corrispondente alla statistica rₛ

Dunque, si procede in modo analogo a r di Pearson. Vanno però distinti due casi:

- Se n ≤ 30 i valori rₛ critici sono tabulati per due livelli di α (.05 e .01) e ipotesi monodirezionale in funzione del numero dei soggetti (non gdl). Quindi in questo caso usiamo la distribuzione rs di Spearman e i relativi valori critici.

- Se n > 30, così come per il coefficiente r di Pearson, esiste una relazione tra rₛ e t di Student. In questo caso procederemo usando la distribuzione di probabilità t (trasformare rs di Spearman in t di student)

In quale situazione ci troviamo? Abbiamo una popolazione dalla quale estraiamo 1 campione. Poi abbiamo due variabili ordinali.

La procedura è la seguente

1. Scelta del test statistico (di significatività)

Si calcola rₛ

2. Definizione dell’ipotesi:

Confronto con la popolazione di riferimento

- H₀: ρₛ = 0

- H₁: ρₛ ≠ 0 (bidirezionale solo se n > 30)

- H1: ρₛ > 0 oppure ρₛ < 0 (monodirezionale se n < 30)

3. Fissare il livello di significatività α:

Si delinea la regione di rifiuto in base a:

- α (= .05; .01; .001; ecc.)

- n (per n < 30) oppure gdl = n-2 (per n > 30)

- H₁ (monodirezionale per n < 30)

- H₁ mono-/bi-direzionale per n > 30

trovando un rₛ critico (per n < 30) oppure tcritico (per n > 30) sulla Tavola

4. Associare una probabilità ad H₀

Quando n < 30, si associa una probabilità ad H₀ calcolando rₛ e confrontandola con rₛ critico:

Quando n > 30, si associa una probabilità ad H₀ calcolando rs trasformandolo in t e confrontandolo con tcritico

5. Decisione su H₀ (⇒ H₁): Il confronto avviene tra rₛ e rₛ critico per n < 30, Oppure tra t e tcritico per n > 30

Se |rₛ| < |rₛ critico| oppure |t| < |tcritico| = p > α

- Si accetta H₀ ⇒ L’ipotesi di un’assenza di relazione (ρₛ = 0) è probabilmente vera ⇒ La relazione tra le due variabili non è significativa.

Se |rₛ| > |rₛ critico| oppure |t| > |tcritico| = p < α

- Si rifiuta H₀ ⇒ Si accetta H₁ ⇒ L’ipotesi di un’assenza di relazione (ρₛ = 0) è probabilmente falsa ⇒ La relazione tra le due variabili è significativa.

Esempio n < 30

ESEMPIO (precedente).

Abbiamo osservato i comportamenti aggressivi e quelli oppositivi di 14 adolescenti durante le loro interazioni con i genitori. Vogliamo verificare se esiste una relazione fra comportamenti aggressivi e quelli oppositivi.

Essendo n < 30 allora ho la seguente procedura

1. Scelta del test statistico (di significatività):

Ho 1 Campione con n = 14. Ho poi 2 variabili ordinali “compotamento aggressivo” e “comportamento oppositivo”. Si sceglie rₛ (r di Spearman)

2. Definizione dell’ipotesi:

H₀: ρₛ = 0 → assenza di relazione;

H₁ (monodirezionale): ρₛ > 0 → relazione positiva tra i due comportamenti

3. Si delinea la regione di rifiuto di H₀:

Si fissa α = .01 per n = 14.

Si trova un rₛ critico = .645 (sulla tavola)

4. Associare una probabilità ad H₀:

Calcolo rₛ con la seguente formula

5. Decisione su H₀ (⇒ H₁)

Facciamo confronto rₛ con rₛ critico

Poiché rₛ = (.29) < rₛ critico (= .645) si accetta H₀

Quindi la relazione tra comportamenti aggressivi e oppositivi non è significativa

Esempio n > 30

Se invece ho n > 30 allora ho la seguente procedura

1. Scelta del test statistico (di significatività):

Ho 1 Campione con n = 40. Ho poi 2 variabili ordinali “compotamento aggressivo” e “comportamento oppositivo”.

Si sceglie rₛ (r di Spearman) che viene trasformata in t di Student.

2. Definizione dell’ipotesi:

H₀: ρₛ = 0 → assenza di relazione;

H₁ (monodirezionale): ρₛ > 0 → relazione positiva tra i due comportamenti

3. Si delinea la regione di rifiuto di H₀:

Si fissa α = .01 per gdl = 40 -2 = 38 e H1 monodirezionale. Trovo un tcritico pari a 2.423 (sulla tavola)

4. Associare una probabilità ad H₀:

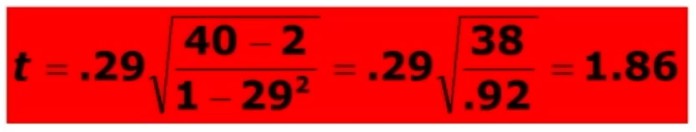

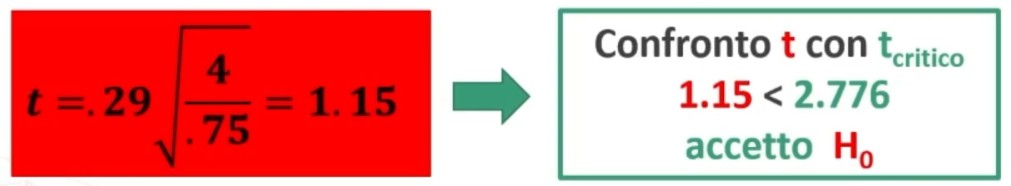

Dopo aver calcolato rₛ lo trasformiamo in t

5. Decisione su H₀ (⇒ H₁)

Effettuiamo il confronto t con tcritico

Poiché t (= 1.86) < tcritico (= 2.423) si accetta H₀

La relazione tra comportamenti aggressivi e oppositivi non è significativa.

Se il valore di t non è (oppure è) significativo non lo è (oppure lo è) anche rₛ

Quando una o entrambe le variabili non costituiscono già una graduatoria, dobbiamo trasformarle in ranghi.

Facciamo un esempio.

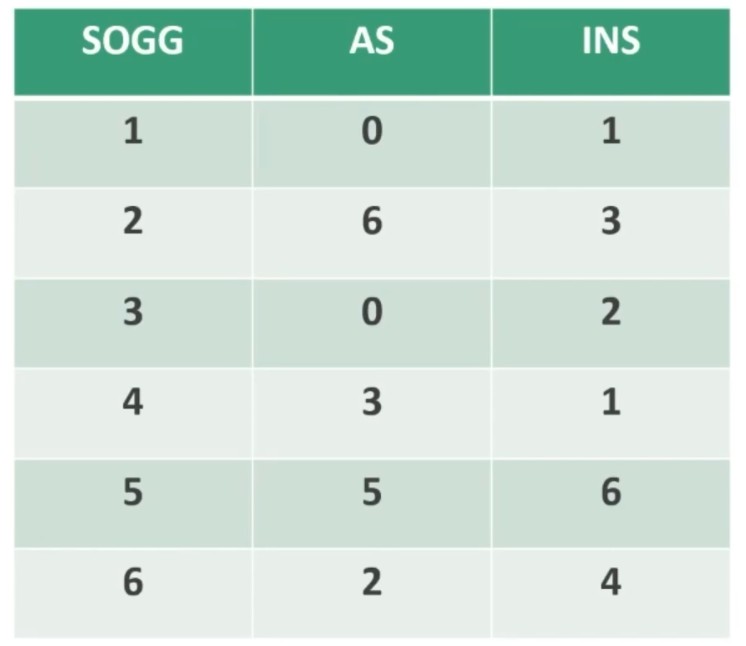

Misuriamo se i pazienti affetti da Autostima (0 “bassa”; 6 “alta”) e insonnia (numero di notti in una settimana in cui si ha difficoltà ad addormentarsi).

Sono associate? (α = .05)

Le due variabili non costituiscono in questa forma delle graduatorie.

Se tuttavia consideriamo ordinali le due misure (o anche almeno una) debbo trasformarle in ranghi prima di calcolare la loro associazione.

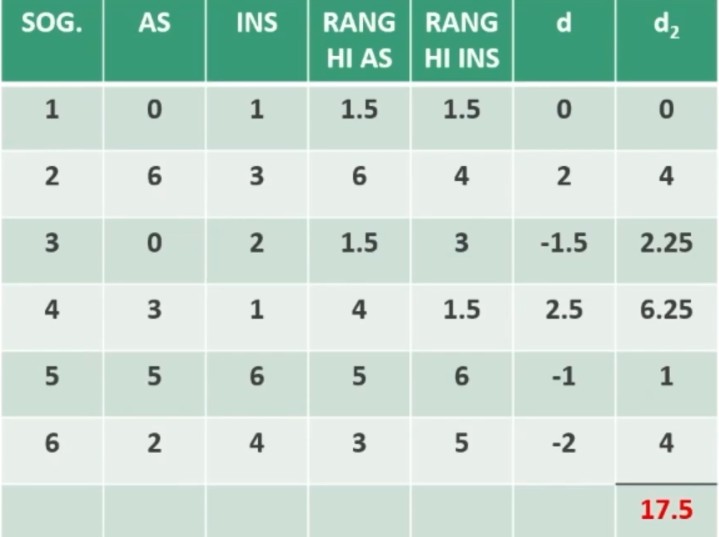

Per fare ciò debbo ordinare per ciascuna variabile (autostima e insomia) i soggetti in modo crescente, e in questo modo protremo assegnare dei ranghi. Se due punteggi sono uguali assegno un rango medio (si vede i valori con colore arancione).

Ora unisco la graduatoria in un’unica tabella, stando attento a mantenere sulla stessa riga i punteggi e i ranghi del medesimo soggetto.

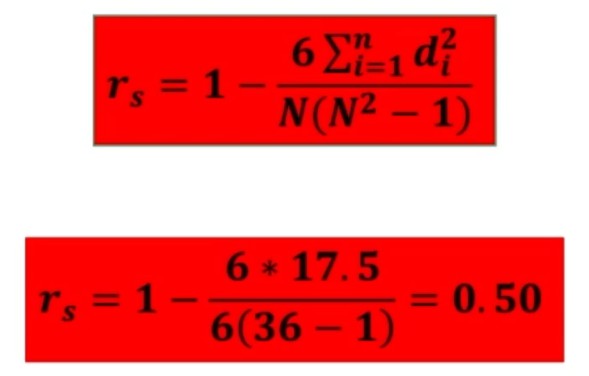

A questo punto calcolo rs

Per testare l’ipotesi nulla possiamo:

- Usare un’approssimazione alla t (per “grandi” campioni)

- Usare una tavola con valori “esatti” di rₛ (per “piccoli” campioni)

Il problema è che la tavola dei valori r Di Spearman prevede valori critici solo per ipotesi monodirezionali (poco frequenti).

Dunque, è consigliabile usare la trasformazione in t (gdl = n – 2):

Il coefficiente di correlazione tra variabili dicotomiche rphi

Questo coefficiente misura la relazione fra due variabili nominali dicotomiche, ad es. la relazione tra due item di un test con risposta giusto/sbagliato.

Il coefficiente di correlazione rphi va calcolato quando i dati sono costituiti da due variabili categoriali a due livelli.

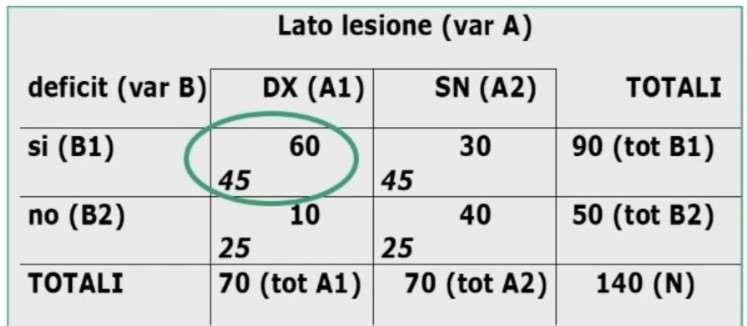

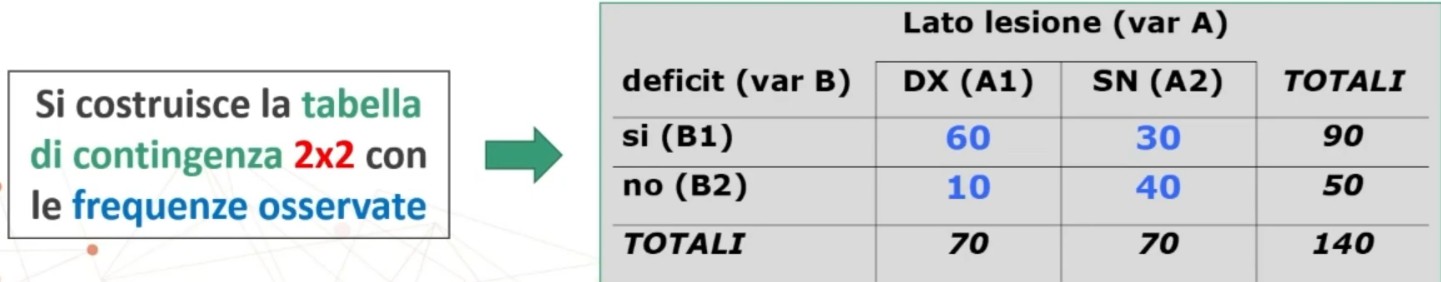

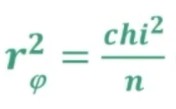

Facciamo un esempio: In un gruppo di pazienti cerebrolesi si vuole valutare se la presenza di deficit del campo visivo è in relazione con il lato della lesione. Quindi ho

- Lesione DX/SN = variabile dicotomica A

- Deficit di campo visivo SI/NO = variabile dicotomica B

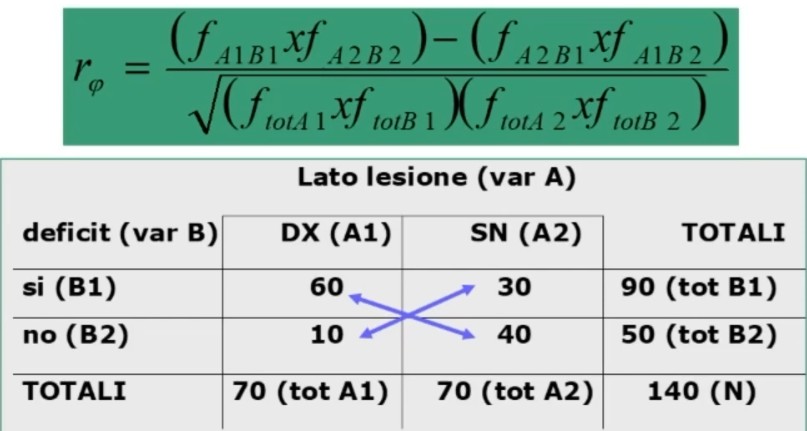

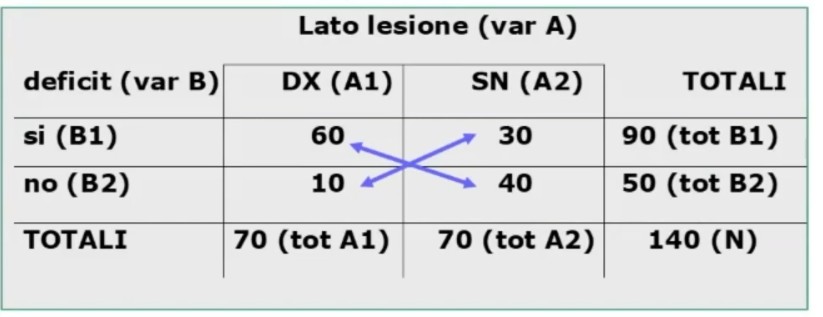

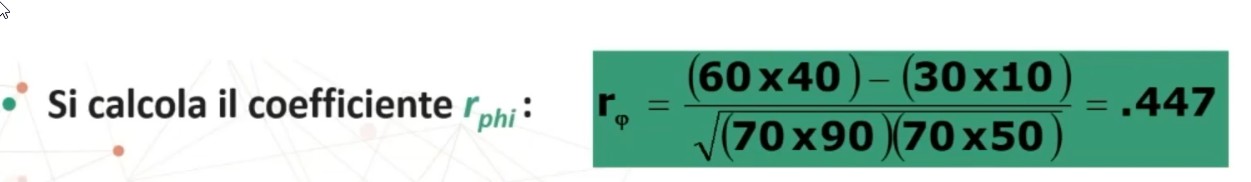

Il calcolo di rphi si basa sul conteggio delle frequenze. La formula è

Verifica delle ipotesi su rphi

Come posso valutare se la relazione sintetizzata tramite il coefficiente di correlazione rphi è significativa, cioè probabilisticamente diversa da zero?

La verifica dell’ipotesi viene indicata con πphi (pi greco phi) ovvero il parametro nella popolazione corrispondente alla statistica rphi.

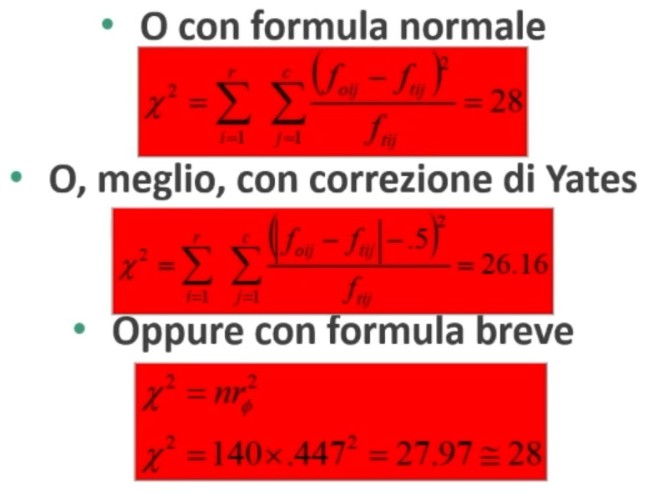

È stato dimostrato che

e pertanto si associa una probabilità ad H₀ (πphi = 0 oppure ρ = 0) delineando la regione di rifiuto attraverso il χ² critico.

Facciamo un esempio: In un gruppo di pazienti cerebrolesi si vuole valutare se la presenza di deficit del campo visivo (var. B SI/NO) è in relazione con il lato della lesione (var. A DX/SN)

1. Scelta del test statistico (di significatività):

1 Campione: n = 140; 2 variabili dicotomiche “campo visivo” e “lesione”.

Scelgo rphi (indagine della relazione tra due variabili dicotomiche)

2. Definisco le ipotesi:

Ho le seguenti ipotesi

- H₀: πphi = 0 (assenza di relazione)

- H₁: πphi ≠ 0 (presenza di una relazione)

3. Delineo la regione di rifiuto di H₀:

Fissiamo α = .01

gdl = (2 righe – 1)(2 colonne – 1) = 1 → sulla tavola, trovo χ² critico = 6.64

4. Associare una probabilità ad H₀:

Dopo aver calcolato rphi utilizzo la stessa tabella di contingenza per calcolare la statistica test χ². Andiamo a confrontare le frequenze osservate con le frequenze teoriche.

Calcolo le frequenze teoriche per ogni cella

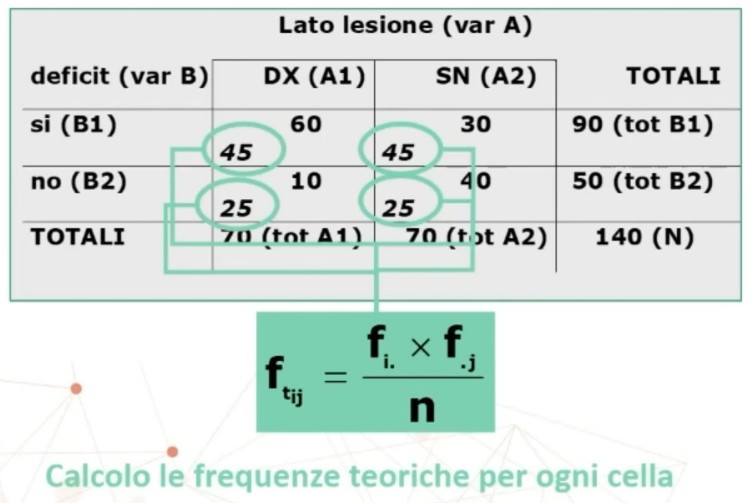

Ora possiamo andare a confrontare queste frequenze teoriche con quelle osservate atraverso la formula che usiamo per il calcolo per il χ².

Queste 3 formule sono pressochè equivalenti

5. Decisione su H₀ (⇒ H₁):

Facciamo il confronto

χ² > χ² critico (28.0 > 6.64) ⇒ p < .05

Quindi rphi (.447) è significativo ⇒ Rifiuto H₀

Ne concludo che la presenza del deficit è associata alla localizzazione della lesione. Osservando i valori attesi, capisco che la lesione a destra è più spesso associata alla presenza del deficit, mentre la lesione a sinistra più spesso non procura deficit.